Eduardo Castelló Ferrer ha participado en la ponencia: “Datos, inteligencia artificial y complejidad, una visión de la sociedad del futuro”, donde ha afirmado que “este mundo en el que vivimos o en el que vamos a vivir no es nosotros contra la máquina, sino que es nosotros con la máquina”.

Durante el evento, organizado por la Escuela Técnica Superior de Ingeniería Informática (Etsinf) de la Universidad Politécnica de Valencia (UPV), el doctor en Ingeniería Robótica de la Universidad de Osaka (Japón) ha manifestado que los robots y la Inteligencia Artificial (IA) extenderán a la especie humana, más que consumirla.

El encuentro también ha sido preparado por el grupo de trabajo Human Dynamics del MIT Media Lab, del cual forma parte Castelló Ferrer; la UPV y la colaboración del periodista y reconocido escritor, Adolfo Plasencia, así como del proveedor especializado Occentus Network.

Precisamente, el MIT Media Lab acaba de introducir un nuevo concepto denominado “Autonomía en la que se puede confiar”, donde la palabra confianza juega un papel fundamental.

“El mundo de la Inteligencia Artificial, de los robots, de la automatización, es un mundo como muy polémico porque tenemos como dos tipos de personas hablando sobre este mundo”.

A juicio de Ferrer, existen personas que lo consideran una oportunidad para dejar que la robótica lo haga todo y otras como el principio del fin.

Lo que sí ha admitido es que puede llegar un momento en que la complejidad de la red de dispositivos sea tan grande, que pueda superar los límites cognitivos humanos para entenderlos.

Esto, tomando en cuenta que se ha pasado de teléfonos fijos a móviles, a coches y casas inteligentes, agendas inteligentes y un sinfín de máquinas autónomas.

“Si todos los dispositivos son iguales tendremos una complejidad lineal, si son heterogéneos se puede incrementar exponencialmente. Es muy probable que en el futuro no lleguemos a comprender qué es lo que está pasando alrededor nuestro y la complejidad de los dispositivos que tenemos alrededor”.

Para el experto, sería genial que los humanos puedan tener herramientas y conocimientos para permitir que esas máquinas sigan haciendo lo que no se quiere hacer y aumenten su complejidad, sin llegar al punto de no entenderlos y que superen el nivel cognitivo humano.

Confianza en la máquina

Eduardo Castelló Ferrer considera que, en el mundo digital, la confianza es más difícil por los agujeros que se han dejado en los diseños.

Cree que el Blockchain no es la cura a los males por las muchas deficiencias que le atribuye, “pero se basa en una serie de ideas muy interesantes que, aplicadas a otros campos, pueden dar un salto significativo en la tecnología de hoy”.

“Cuando concentras esa confianza, esos datos, en un sitio, ese sitio se vuelve vulnerable. Esa información puede ser usada en contra de la gente que está intentando utilizarlo”.

Insiste en que hay una tensión en el mundo digital sobre la forma de maximizar la utilidad de los datos sin romper su privacidad.

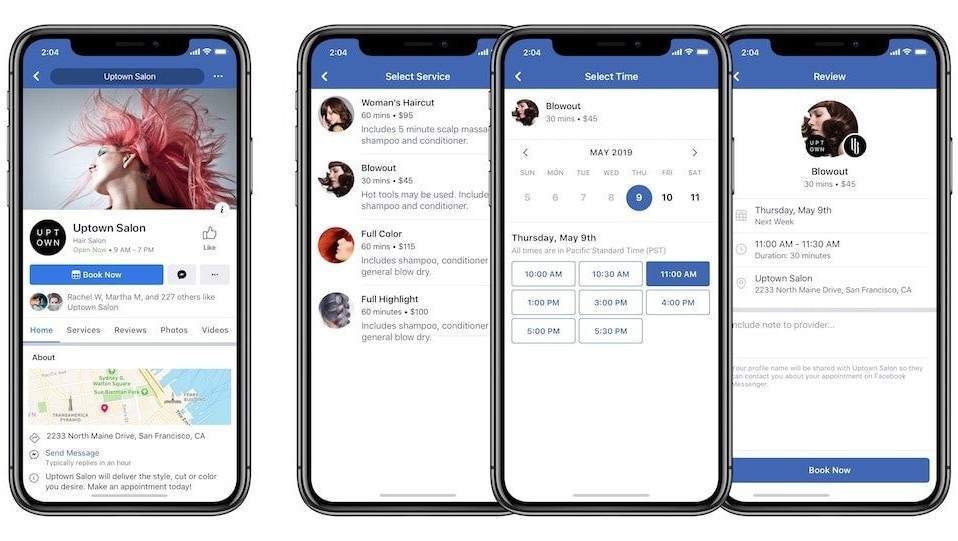

Es por ello que en el MIT Media Lab han generado un proxy que no le permite acceder a información particular en bases de datos, pero sí puede hacer preguntas a esas bases de datos y recibir respuestas agregadas; no puede copiarlos, pero sí conocer la información de esos datos.

“Yo quiero saber cuál es la tasa de éxito en niños de cinco a siete años sobre una terapia, no necesito saber los datos en crudo, lo que necesito saber es 85 %, por ejemplo. Yo ahí puedo generar conocimientos sin ver los datos”.

Esa arquitectura se ha colocado con una interfaz robótica y ha permitido que un robot, mediante su terapia, pueda hacer preguntas a esas bases de datos protegidas y recibir respuestas.

Lo interesante de esto, según Castelló Ferrer, es que el robot puede cambiar su actitud y aprender con esos datos privados para ayudar a los niños en su terapia. Además, los padres de esos niños pueden auditar los robots.

Seguridad robótica

A pesar de los beneficios de la robótica, la amenaza está latente. Y es que si un robot es infectado con información errada, puede dañar a todo su conjunto. Los investigadores del MIT Media Lab intentan ver este tipo de problemas y generar tecnología que pueda solucionarlos.

Han tomado algoritmos del Estado del Arte (SoA, en inglés) que permiten que los robots puedan hablar entre ellos (a través de transacciones de Blockchain) y llegar a un consenso.

El resultado ha sido que los algoritmos del SoA han ofrecido una respuesta muy similar a las del Blockchain o cadena de bloques.

“Si yo soy un robot malicioso y voy a ti y te digo: blanco es el color mayoritario, y generamos una transacción sobre eso, pero un minuto después yo voy a Alfredo y le digo: no, negro es el color mayoritario, en ese momento si generamos una transacción se genera una inconsistencia en el libro de cuentas”.

Esa información se propaga por todo el enjambre y todos pueden saber que existe un problema y cuál robot lo ha generado. Como resultado, se saca del consenso a ese robot no confiable y se generan mejores resultados.

“Lo interesante es que una sociedad de robots se ha autogestionado para quitarse a la gente que no es confiable”.

Al hacer esto posible, Eduardo Castelló Ferrer está seguro de que se pueden generar nuevos modelos de negocios, entre otros aspectos positivos para la sociedad.