Henry Silverman, gerente de Producto en Facebook, ha anunciado un programa piloto para ayudar a los verificadores de información a identificar contenido falso en la plataforma.

El programa funciona con un grupo de revisores de la comunidad que se apoyan con un modelo de Aprendizaje Automático (Machine Learning, ML).

Ha explicado que la compañía ha logrado avances significativos en la reducción de contenido falso a través de su asociación con algunos de los principales verificadores de información del mundo.

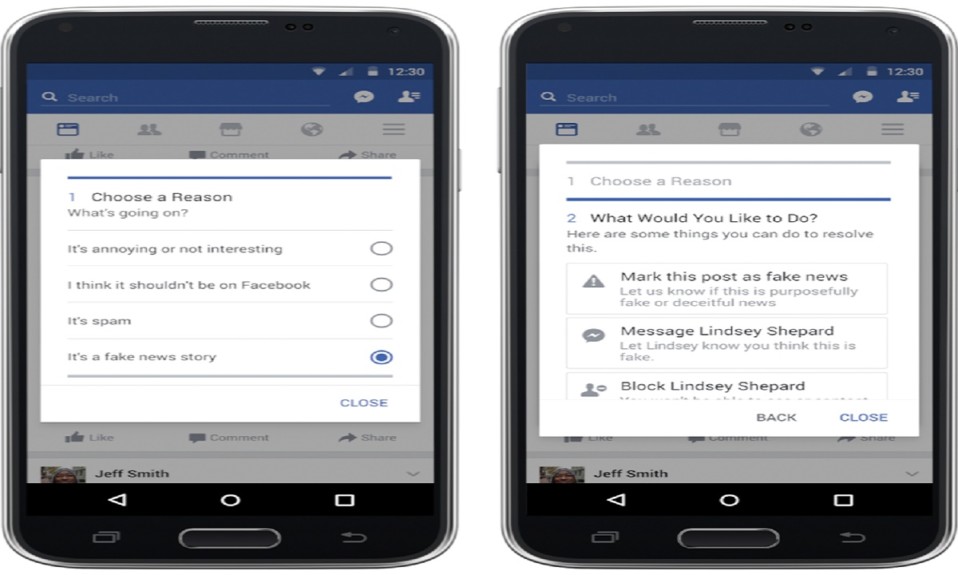

Ahora, con este programa piloto, ayudan a estos verificadores de información a detectar rápidamente si un grupo representativo de usuarios de Facebook ha encontrado algo que pruebe o contradiga una información. El objetivo es brindarle apoyo a los verificadores para identificar contenido falso más rápido.

Silverman ha indicado que el grupo de revisores de la comunidad trabaja como investigador para encontrar información que pueda contradecir los engaños en línea más obvios o corroborar otras afirmaciones.

“Estos revisores de la comunidad no son empleados de Facebook, sino que serán contratados a través de uno de nuestros socios verificadores y no tomarán decisiones finales por sí mismos”.

Señaló que sus hallazgos se compartirán con los verificadores de información como contexto adicional para que ellos, posteriormente, realicen su propia revisión oficial.

En concreto, si existe una publicación donde se afirma la muerte de una celebridad y los revisores de la comunidad no encuentran ninguna otra fuente que informe sobre esa noticia, podrán indicar que el fallecimiento no ha sido corroborado.

Y es que pueden observar contenido confiable donde se indique, por ejemplo, que esa celebridad ofrecerá un concierto ese día.

“Nuestros socios verificadores verán esta información a medida que revisen y califiquen la publicación”.

Verificando contenido falso

En la compañía de Mark Zuckerberg han comenzado a explorar la idea de este programa piloto a principios del año pasado. Desde entonces, han trabajado con expertos y socios en muchos campos para comprender cómo pueden apoyar mejor a sus socios de verificación en su esfuerzo por revisar el contenido más rápido.

Es por esto que han decidido utilizar la tecnología de Aprendizaje Automático para el funcionamiento del programa piloto.

El modelo de Aprendizaje Automático, entonces, identifica información potencialmente falsa utilizando una variedad de señales.

Revisores de la comunidad representativos

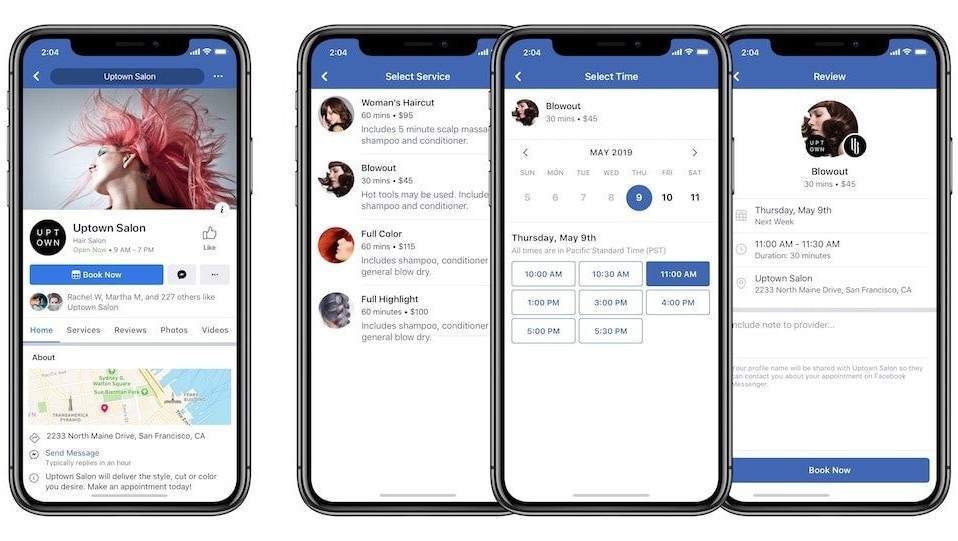

La plataforma social se ha asociado con YouGov para garantizar que el grupo de revisores de la comunidad represente la diversidad de personas en Facebook.

Se trata de una firma global experta en opinión pública y datos, la cual realizó un estudio independiente sobre los revisores de la comunidad y usuarios de la popular red social.

El estudio de YouGov ha determinado que los requisitos utilizados para seleccionar a los revisores de la comunidad condujeron a un grupo que es representativo de la comunidad de Facebook en los Estados Unidos y que refleja los diversos puntos de vista de los usuarios de la plataforma, incluyendo sus ideologías políticas.

“También encontraron que las calificaciones de este grupo son generalmente consistentes con lo que la mayoría de las personas que usan Facebook probablemente concluirían”.